企业级产品的数据分析是驱动产品迭代、优化用户体验和提升商业价值的关键环节。在数据分析的整个流程中,数据处理作为基础且核心的一步,直接影响分析结果的准确性和可用性。本文将详细介绍企业产品如何进行有效的数据处理。

一、数据收集与整合

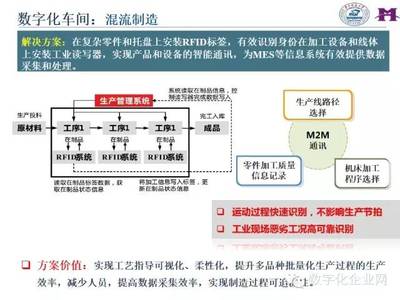

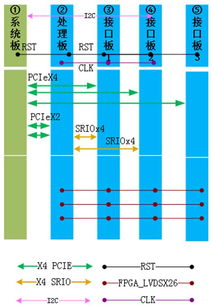

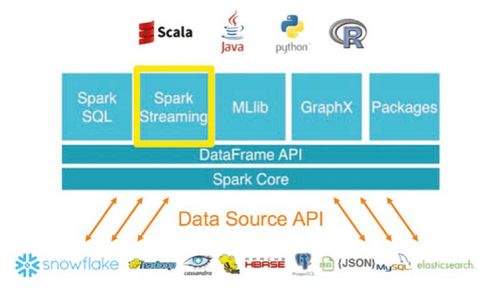

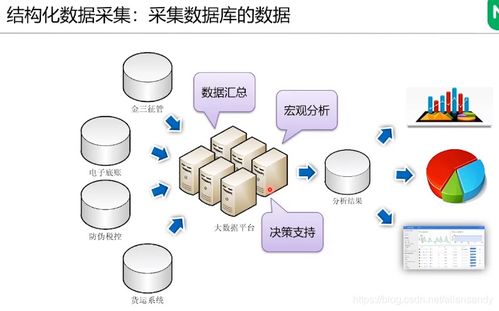

企业产品通常涉及多源数据,包括用户行为数据(如点击、浏览、使用时长)、业务数据(如订单、交易、客户信息)、系统日志数据以及可能的外部数据(如市场趋势、竞争对手信息)。数据处理的第一步是通过API接口、数据埋点、数据库同步或日志采集工具(如Flume、Kafka)将这些异构数据集中收集到统一的数据仓库(如Hadoop、Snowflake或云平台的数据湖)中,确保数据的全面性和时效性。

二、数据清洗与预处理

原始数据往往包含噪声、缺失值、重复项或异常值,需通过清洗提升数据质量。常见处理包括:

- 去重与标准化:消除重复记录,统一数据格式(如日期、货币单位)。

- 缺失值处理:根据业务场景采用插值、删除或默认值填充。

- 异常值检测:利用统计方法(如3σ原则)或机器学习识别并处理异常数据。

- 数据转换:例如,对非结构化文本数据进行分词和向量化,或将分类数据编码为数值型。这一步骤通常借助工具如Python的Pandas、Spark或SQL脚本实现。

三、数据建模与特征工程

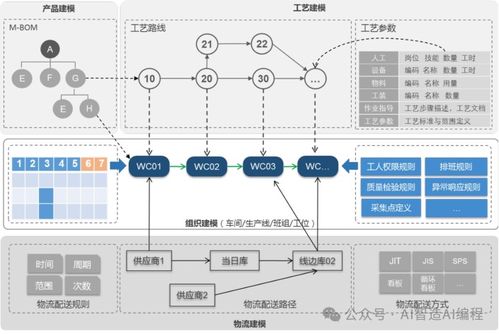

在清洗后,数据需进一步加工以支持分析模型。这涉及:

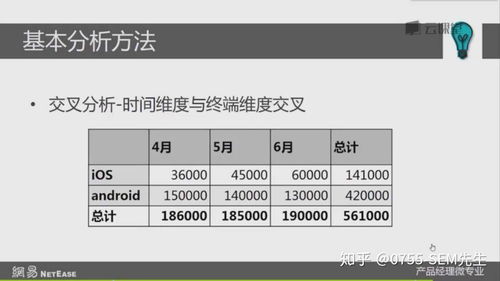

- 数据聚合:按时间、用户群等维度汇总数据(如日活跃用户数、平均交易额)。

- 特征提取:从原始字段衍生新特征,例如从用户行为序列中计算留存率、转化漏斗等指标。

- 数据关联:连接不同数据源,构建统一视图(如结合用户画像与交易记录)。企业常使用ETL(提取-转换-加载)流程或ELT(提取-加载-转换)现代架构,配合工具如Airflow、dbt实现自动化。

四、数据存储与管理

处理后的数据需高效存储以供分析使用。企业会根据数据热度选择存储方案:热数据(频繁访问)存入高速数据库(如ClickHouse、Redis),冷数据则归档至低成本存储。实施数据治理策略,包括元数据管理、数据质量监控和访问权限控制,确保数据安全合规。

五、数据验证与迭代

数据处理不是一次性任务,而需持续优化。通过A/B测试、数据一致性校验和业务反馈,定期评估处理流程的有效性。例如,监控关键指标(如数据覆盖率、处理延迟)并调整清洗规则或特征定义,以适配产品迭代和业务变化。

企业产品的数据处理是一个系统化工程,强调从收集到验证的闭环管理。它不仅是技术实现,更需与业务目标紧密结合——只有高质量的数据基础,才能支撑后续的深度分析和智能决策,最终推动产品持续增长。